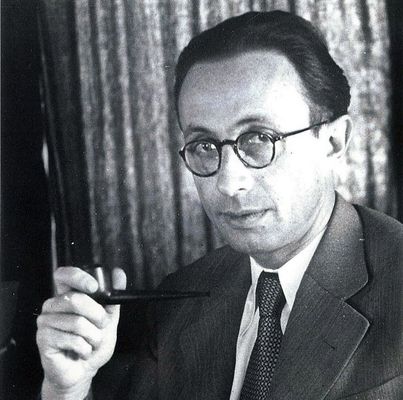

Cette éthique est principalement portée par le philosophe allemand Hans Jonas pour qui le progrès humain doit être encadré par des fondements moraux. Nous devons prendre conscience et assumer notre responsabilité par rapport aux générations futures, nous ne pouvons plus nous permettre de chercher à développer sans cesse nos technologie et consommer nos ressources sans penser aux conséquences. Pour Jonas, nous devons envisager les impacts à long terme de nos actions afin prendre de mesures pour minimiser les dégats qu'elles pourraient causer.

Cette éthique se base sur quatre principes :

Nous pensons que cette éthique est la plus intéressante à appliquer à notre sujet. En effet, la question de la responsabilité est primordiale en justice. En cas d’erreur qui doit être tenu pour responsable ? Une IA peut-elle comprendre l’impact de ses décisions et en assumer les conséquences ?

Si nous reprenons la situation où une IA est utilisée pour analyser les dossiers judiciaires et rendre des jugements sur base de ceux-ci. Dans ce cas, les personnes en position de vulnérabilité sont les personnes mises en cause dans le procès ainsi que les potentiels plaignants. Évidemment, la décision rendue a de fortes chances de déplaire à l’une des deux parties mais nous considérerons ici que le jugement le plus juste et objectif possible sera perçu comme correct par tout le monde. Ces personnes seront bien affectées par les décisions de l’IA qui a une certaine autorité sur elles. Nous pourrions donc considérer que l’agent intelligent est responsable de ces gens. Les actuels juges et avocats seront aussi affectés si des IA prennent leur place.

Remplacer des juges humains par des IA peut créer plusieurs menaces :

Pour protéger au maximum les personnes identifiées, il serait déjà préférable d’utiliser les intelligences artificielles comme des outils d’aide à la décision et non comme des décideurs indépendants. Ainsi nous permettons aux juges et avocats de conserver leurs postes et réduisons le problème de responsabilité puisque le juge sera responsable de la sentence finale. De plus, il sera important de mettre en place des systèmes pour s’assurer que l’IA fonctionne bien, des audits réguliers et corriger rapidement les biais. Quoi qu’il en soit, il est important d’approfondir nos connaissances en matière de création d’IA, d’explicabilité et de compréhensions de celles-ci afin de pouvoir les rendre les plus objectives et justes possible en étant capables d’identifier les biais et les erreurs qui pourraient survenir.