L'éthique des vertus selon Aristote

La moralité de nos actes dépend essentiellement du point de vue adpoté. Ainsi, l'éthique transhumaniste n'est pas manichéenne.

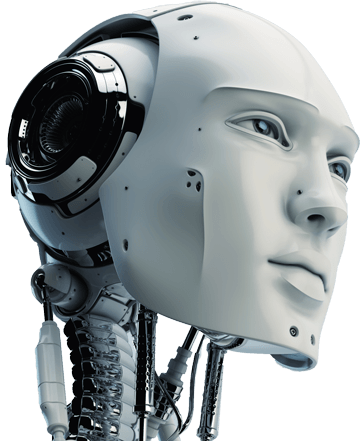

Nous allons effectuer une analyse éthique en abordant les 3 principales voies éthiques. Nous allons d'abord adopter un point de vue eudémoniste au travers de l'éthique des vertus d'Aristote. Nous allons ensuite apporter une vision déontologique par l'éthique des devoirs et l'impératif catégorique d'Emmanuel Kant. Enfin, nous allons étudier la question à l'aide de l'éthique conséquentialiste et plus spécifiquement l'utilitarisme de Jérémy Bentham.

Selon le blog de la philosophie et de l’éthique, l’éthique de la vertu est définie de la sorte : "L’éthique de la vertu est une théorie morale normative dont l’une des visées essentielles est d’aiderles personnes à prendre de bonnes décisions". Celle-ci a été développée par Aristote. L’éthique des vertus se concentre plus sur l’agent que sur ses actes. Prenons l’exemple d’un ingénieur/scientifique qui fait une découverte majeure et qui pourrait sauver des millions de vies. On pourrait considérer cela très moral car sa découverte permettrait d’aider des millions de personnes. Cependant, il faut s'interroger sur la nature de ses actes. Est-ce par pur altruisme et par envie d’aider son prochain, ou est-ce pour des raisons pécuniaires ? Ou tout simplement pour des questions derenommée ? En effet, nous savons qu’une découverte majeure rime souvent avec une belle renommée et parfois des titres scientifiques. C’est là qu’intervient l’éthique de la vertu car la raison pour laquelle l’acte a été effectué domine sur la bonté de l’acte en lui-même.

Devenir transhumain peut être une chose moralement bien ou non selon les intentions du bénéficiaire. En fait, le transhumanisme permet d’améliorer les conditions physiques humaines et donc de dépasser les limites que la nature nous a imposées. La prothèse transhumaine est donc quant à elle une bonne chose si nous ignorons les pensées de l’utilisateur. Nous allons donc étudier plusieurs cas pour pouvoir illustrer notre point de vue.

Reprenons les cas cités sur la page d'accueil. Pierre, jeune homme de 18 ans voulant devenir joueur de basketball professionnel, est sur le point de signer aux Los Angeles Lakers, son équipe de coeur. Après l’entraînement, celui-ci décide de renter à vélo. Malheureusement, ce soir là fût son dernier tour à vélo car Pierre se fait percuter par un conducteur ivre au volant. Suite à cela, il devient paraplégique. Son unique rêve à l’heure actuelle est de pouvoir pouvoir remarcher un jour. Cet exemple va nous permettre d’illustrer le transhumanisme pour les personnes atteintes d’un handicap. Dans cet exemple, l’intention de l’agent est de retrouver l’usage de ses jambes, ce qui est un besoin naturel et fondamental à tout être vivant. Ce n’est pas dans une volonté d’obtenir de nouvelles jambes bioniques afin de devenir le plus grand sportif de tousles temps. Selon l’éthique de la vertu, l’intention de se faire une transplantation d’un exosquelette ou d’avoir des jambes bioniques pour pouvoir marcher (un besoin fondamental) est moralement correct. James, jeune homme de 21 ans, passionné par la science fiction et ingénieur à l’armée américaine a la possibilité de créer un implant cybernétique qui peut être utilisé par n’importe quelle personne (handicapée ou non) pour améliorer les compétences physiques. Après l’engouement du général sur le succès des test passés par la technologie, celui-ci décide d’armer les soldats avec cela. Certes, le but principal du transhumanisme ici est d’augmenter les compétences physiques mais l’intention du général est de l’utiliser dans le but d’avoir l’avantage en temps de guerre et de tuer des être humains. Dès lors, selon l’éthique d’Aristote, ce n’est pas moralement correct. Thomas et Jean, fondateurs de CyberBioTech International, ont développé des nanorobots qui remplacent les cellules qui tuent les cellules cancéreuses et défectueuses et qui améliorent l’immunité de façon considérable afin de repousser les agents pathogènes avant même qu’ils prolifèrent. Thomas a crée cette technologie pour sauver de millions de vie alors que Jean souhaite uniquement le prix Nobel de médecine ainsi que la notoriété et l’argent qui découlera de cette technologie. Comme dans les cas précédents, nous allons analyser si cela est moral ou non. Les intentions de Thomas et de Jeanne sont pas les mêmes. Selon l’éthique Aristote c’est moralement correct pour Thomas mais pas pour Jean. De façon générale, l’éthique des vertus va affirmer que l’action est morale pour des personnes handicapés ou malades car leurs intention est de retrouver une mobilité normale et non de vouloir améliorer ses compétences physiques pour simplement être plus performant dans un domaine car, comme nous le savons tous, le corps humain a ses limites. En ce qui concerne les personnes qui développent ces artifices, il faut également regarder l’intention avant tout. Si le créateur a travaillé pendant des années sur son projet dans le but d’aider les gens comme Pierre, cela est moral. Par contre, si l’intention était uniquement pécuniaire, alors ce n’est pas moral contrairement à la personne dont l’intention était humanitaire.

L’éthique déontologique ou éthique des devoirs considère la morale selon le respect pur d’une loi morale.

La morale est donc liée à la rectitude du pouvoir, une action n’étant bonne que par pure intention de représenter la loi morale.

Selon Emmanuel Kant, ne sont morales que les actions dont la maxime sera conforme à un impératif catégorique. Cette éthique est

opposée à l’éthique des vertus et à la philosophie eudémoniste puisque la loi morale doit être commandée par la raison, et que

la raison tend à nous éloigner du bonheur (par exemple, dans la philosophie de Rousseau, la lucidité qui tend à l’insatisfaction).

Elle s’oppose également au conséquentialisme qui affirme à contrario que les actes moraux sont à juger en fonction de leurs conséquences.

Une loi morale s'inscrit selon plusieurs principes :

Principe d'universalisation : « Agis uniquement d’après la maxime qui fait que tu puisses vouloir en même temps qu’elle devienne une loi universelle de la nature. »

Principe d’humanisation : « Agis de telle sorte que tu traites l’humanité aussi bien dans ta personne que dans la personne de tout autre, toujours en même temps comme une fin, et jamais simplement comme un moyen. »

Principe de législation universelle : « N’accomplis d’action que selon une maxime telle qu’elle puisse comporter en outre d’être une loi universelle, telle donc seulement que la volonté puisse se considérer elle-même comme constituant en même temps par sa maxime une législation universelle.»

Il est primordial d’adopter un point de vue déontologique sur le transhumanisme dans la mesure où cette technologie connaît une nette progression et est amenée à être mise en service sur le marchéde demain. Si l’on souhaite que tout soit moral il faudrait que le marché du transhumanisme le soit. Il doit pour cela obéir à une loi morale et répondre à des devoirs, non seulement un devoir parfait dû à une non-contradiction de la législation en vigueur ou des impératifs sociaux, mais également un devoir imparfait qui est purement moral, par exemple vis-à-vis des inégalités sociales.

Reprenons le cas de Pierre. Il souhaite retrouver l’usage de ses membres afin, entre autre, dereprendre le sport. Si l’on regarde aux principes érigés par Emmanuel Kant, on peut s’imaginer que la loi "une personne ayant perdu un membre dans un accident peut le récupérer par des moyens transhumanistes" devienne universelle, cela ne poserait pas de problème. On peut non seulement le concevoir mais également le vouloir, ce qui obéit déjà à deux des trois principes énoncés. De plus, l’humanité est une fin en soi, puisque c’est lui qui est l’humain dans le processus et la transhumanisation est une fin pour lui, non un moyen d’arriver à un but. Il souhaite juste pouvoir avoir une vie normale, pas se faire de l’argent en devenant le plus grand sportif de tous les temps à l’aide de la technologie. On peut considérer que l’implantation de membres bioniques serait un acte moral déontologiquement parlant. Si on prend cette fois le cas de James, créateur d’un implant cybernétique dans un but militaire : on peut s’imaginer que cette maxime devienne une loi universelle, on peut bien imaginer que l’humanité continue dans cette voie si toutes les armées avaient recours à cette technologie. Cependant, l’humain est ici utilisé comme moyen et non comme une fin. L’être humain transhumanisé est ici un moyen d’asseoir sa domination militaire. Les agissements de James ne sont pas déontologiquement moraux. Modifions un peu la situation de Thomas et Jean. Imaginons que ceux-ci aient le bagage scienti-fique et technique pour développer des nanorobots tueurs de cellules cancéreuses, mais que ceux-ci s’accordent sur un fait : cela demande bien trop de travail. En effet, Jean ne souhaitant que fortune et récompenses, il estime que son espérance de gain est trop faible. Ils ne vont ainsi pas produire leurs nanorobots. Le principe d’humanisation est, a fortiori, respecté puisqu’il ne touche en aucun cas à l’humanité. Et on respecte le devoir parfait, en effet cette loi universelle pourrait toujours subsister,et ainsi plus aucune avancée technologique ne serait réalisée. Cependant, nul ne peut vouloir que cette maxime constitue une loi universelle, il est préférable que l’homme continue de se développer technologiquement au lieu d’avoir une volonté innée de ne pas progresser. Dans cette situation, Jean et Thomas n’obéissent donc pas au devoir imparfait, et ce n’est pas moral selon l’impératif catégorique de Kant.

Le nom parle pour lui même, l’action sera jugée selon les conséquences qu’elle aura, selon son utilité. Selon Philomedia, on définit cette éthique de telle manière : Conséquentialisme : «le jugement de la moralité d’une action se fait en fonction des conséquences de cette action (ici, mentir pourrait être justifié par le fait de préserver une personne, de ne pas l’inquiéter... Cf. également la notion d’utilitarisme).» On admet généralement que cette éthique peut être simplifiée par la formule "un acte bon est un acte qui a de bonnes conséquences". Selon Jérémy Bentham, l’être humain est mû par la peine et le plaisir. Une action doit être effectuée ou non en fonction de la balance entre plaisir et peine (pain / gain). Si une action engage plus de plaisir que de peines, il serait moral de l’effectuer selon cette éthique. Avec quelques hypothèses et simplifications, le but serait alors de maximiser l’utilité nette d’une action, selon plusieurs critères (durée et intensité, proximité, certitude, ...) en respectant un principe d’égalité.

Apparu depuis des décennies dans les oeuvres de fiction, le transhumanisme constituera prochainement une nouveauté dans le quotidien l’homme. Si le thème du transhumanisme crée bien un débat, c’est celui des conséquences que cela aura sur la société telle que nous la connaissons. Il faut se poser la question dès à présent pour éviter des situations catastrophiques à l’avenir.

Pour Pierre, il est évident que l’opération faisant de lui un transhumain a une forte utilité en terme de plaisir. Il réalise son rêve de pouvoir à nouveau remarcher et peut-être même de pouvoir reprendre le sport. Les douleurs associées à cette action se résument à l’éventuelle amertume des futurs concurrents de Pierre sur le terrain de basket-ball et les douleurs physiques associées à l’opération qui ferait de lui un transhumain. Le plaisir est énorme par rapport à la douleur, c’est donc une action morale d’un point de vue utilitariste.

James, quant à lui, utilise le transhumanisme à des fins militaires. Pour ce qui est du plaisir, évidemment, James aurait le plaisir de voir que son travail porte ses fruits et pourrait profiter des rentrées financières qui en découlent. D’ailleurs, l’armée utilisant cette technologie aurait le plaisir de la victoire. On sait d’ailleurs qu’une victoire sur le champ de bataille est bénéfique pour la nation et donc pour la population, au moins financièrement. Mais la douleur est autrement plus importante pour toutes les vies sacrifiées dans ce processus. Les proches des victimes auront inéluctablement une douleur démesurée, la balance penche donc nettement vers la douleur qui est autrement plus importante que le plaisir ici. Cette action n’est donc pas "bonne" à effectuer d’un point de vue conséquentialiste.

Les fondateurs de CyberBioTech International génèrent évidemment une bonne quantité de plaisir pour toutes les personnes atteintes d’un cancer. Thomas aura de son côté le plaisir de contempler le nombre de vies sauvées et ce en partie grâce à lui, tandis que Jean aura du plaisir d’une autre manière, puisqu’il augmente ses chances d’avoir des récompenses et des distinctions. De plus, ces récompenses et distinctions feront sûrement, même si cela reste dans une moindre mesure, plaisir à Thomas. La douleur se fera ressentir pour la concurrence de CyberBioTech International et peut-être pour les potentiels scientifiques se disputant le prix Nobel de médecine. Le plaisir est clairement

plus représentatif que la douleur, dans le modèle de Bentham, il faudrait donc être favorable à cette action.